Google I/O 2016: "Tensor-Prozessoren" halfen beim Go-Sieg

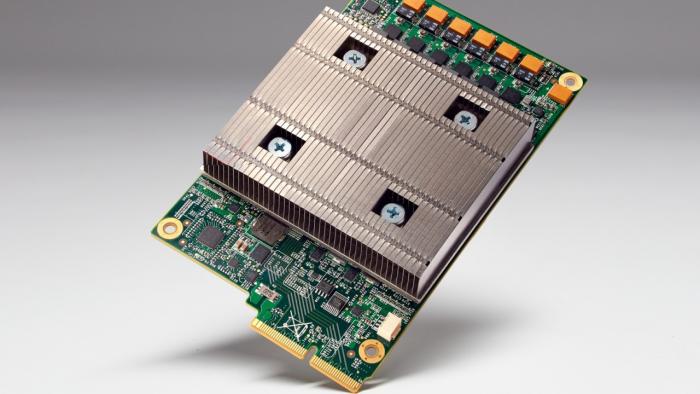

Unter dem Kühlkörper dieser Steckkarte sitzt eine Tensor Processing Unit (TPU).

(Bild: Google)

Google hat selbst Spezialprozessoren namens Tensor Processing Units entwickelt, die Deep-Learning- beziehungsweise KI-Algorithmen beschleunigen; sie waren auch am Sieg von AlphaGo gegen Lee Sedol beteiligt.

Auf der Google I/O 2016 [1] informierte Urs Hölzle, Chef der technischen Infrastruktur, erstmals über die hauseigenen Tensor Processing Units (TPUs). Dabei handelt es sich um von Google selbst entwickelte Spezialprozessoren, die Algorithmen der Software-Bibliothek TensorFlow für KI beziehungsweise Deep Learning [2] besonders schnell und effizient verarbeiten. Laut einem Blog-Eintrag von Hardware-Entwickler Norm Jouppi arbeiten schon seit mehr als einem Jahr TPU-Systeme in Google-Rechenzentren. Sie waren auch an der KI AlphaGo beteiligt, die den derzeit stärksten menschlichen Go-Spieler Lee Sedol bezwang [3].

(Bild: Google)

Weitere Details zu den Tensor-Prozessoren waren den Google-Mitarbeitern bisher kaum zu entlocken. Gegenüber US-Medien erklärte Hölzle, die Spezialchips (ASICs) lieferten deutlich höhere Effizienz als eine ebenfalls denkbare FPGA-Implementierung. Außerdem verriet er noch, dass schon zwei Chip-Varianten von zwei verschiedenen Auftragsfertigern im Einsatz sind.

Doch weder die bei der Herstellung verwendeten Strukturbreite noch die eigentlichen Produzenten der Chips wollte er nennen. Auch zur Leistungsaufnahme gab es keine Angaben – und auch keinen Performance-Vergleich zu x86-Prozessoren oder Rechenbeschleunigern.

Laut Blog von Norm Jouppi [4] spielen die TPUs nicht bloß Go, sondern arbeiten bereits in Google-Produkten mit, etwa bei Google StreetView oder im Suchfilter RankBrain. Entwickler können TensorFlow [5] über die Plattform Google Cloud Machine Learning [6] nutzen, die sich allerdings noch im Alpha-Stadium befindet. Wie stark an diesem Cloud-Dienst aber auch TPUs beteiligt sind, wurde wiederum nicht konkret verraten.

Weitere Google-Chips dürften folgen

Google kooperiert mit IBM im OpenPOWER-Konsortium [7] und tüftelt an Plattformen, die OpenPOWER-Prozessoren und beispielsweise Nvidia-Tesla-Karten koppeln, ebenfalls zur KI-Beschleunigung. Auch an ARMv8-SoCs für Server zeigt Google mittlerweile öffentliches Interesse [8]. Schon 2010 hatte Google die von ehemaligen P.A.-Semi-Mitarbeitern gegründete Chip-Designfirma Agnilux übernommen [9].

Wie das Beispiel der TPU wieder einmal zeigt, hält Google die eigenen Entwicklungen streng geheim. Daran ändern auch vermeintlich offenherzige StreetView-Visiten in Google-Rechenzentren [10] nichts: Dort ist nur solche Technik zu sehen, die Google auch zeigen will. (ciw [11])

URL dieses Artikels:

https://www.heise.de/-3210953

Links in diesem Artikel:

[1] http://www.heise.de/thema/Google-I%E2%88%95O

[2] http://www.heise.de/thema/K%C3%BCnstliche-Intelligenz

[3] https://www.heise.de/news/Google-KI-AlphaGo-siegt-in-der-ersten-Partie-gegen-Lee-Sedol-3131120.html

[4] https://cloudplatform.googleblog.com/2016/05/Google-supercharges-machine-learning-tasks-with-custom-chip.html

[5] https://www.tensorflow.org/

[6] https://cloud.google.com/ml/

[7] https://www.heise.de/news/OpenPOWER-Summit-POWER9-Pascal-FPGAs-und-Open-Compute-3164345.html

[8] https://www.heise.de/news/ARM-Prozessoren-fuer-Server-sollen-2017-durchstarten-3176448.html

[9] https://www.heise.de/news/Google-kauft-Prozessorentwickler-mit-ehemaligen-Apple-Mitarbeitern-982621.html

[10] https://www.heise.de/news/Google-erlaubt-Einblick-in-seine-Rechenzentren-1731550.html

[11] mailto:ciw@ct.de

Copyright © 2016 Heise Medien